’Ride along’ Tesla FSD (Supervised)

’Ride along’ Tesla FSD (Supervised) – Part 1.

(Part-2 handler om det mere sikkerhedsmæssige, moralske, etiske, økonomiske og ikke mindst tillid til Tesla, primært baseret på mine egne erfaringer og holdninger.)

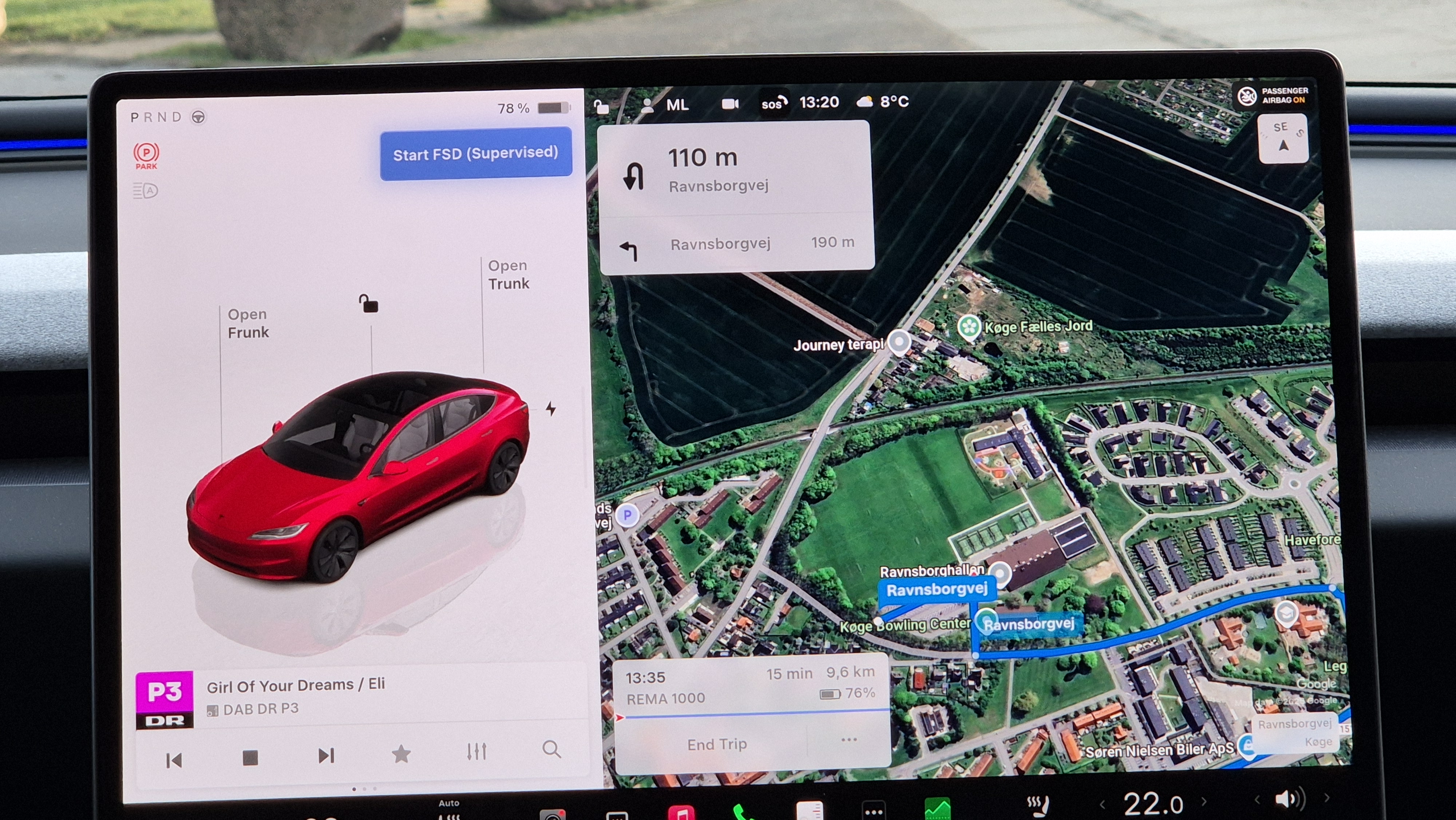

Jeg var i starten af året ude og køre FSD (Supervised) med Tesla i Køge.

Jeg havde forinden gjort mig nogle tanker om, hvordan denne prøvetur skulle foregå. Jeg har set flere videoer, hvor bilen bliver udfordret med småveje og storbyer. Men jeg følte ikke rigtig et behov for at gentage det samme. Jeg tog i stedet udgangspunkt i min daglige ture i min model Y (Juniper), og de problemer jeg oplever med den og dens Autopilot.

Lad mig lige sige med det samme - Jeg er klar over at Autopilot (herefter, AP) er noget helt andet end FSD (Supervised). Men der er alligevel ting i det som jeg, rent personligt, kan bruge til at se, hvad FSD så kan, som AP, grundet flere forskellige omstændigheder, ikke kan. På den måde er det fair at lave den sammenligning. Det er desuden turen som min bil vil skulle køre en stor del af dens levetid. Så det er i allerhøjeste grad relevant. Også selvom den del af turen basalt set er ret kedelig med ganske få udfordringer, set fra et teknisk og trafikalt synspunkt.

Den flinke Tesla medarbejder indvilliget i at tage turen fra Tesla Køge og til Karise kirke via rute 209 og retur. Det er den rute jeg kører meget ofte. Og jeg kender den efterhånden så godt, at jeg ved præcist hvor AP kan/ikke kan håndtere det, samtidig med jeg ved, hvornår det skyldes reelle begrænsninger i AP og hvornår det skyldes basale fejl/tåbelige beslutninger i softwaren. Sidstnævnt er der nemlig en hel del af.

Jeg skal ikke kede jer med at genskabe hele turen i detaljer, da det vil tage for lang tid. I stedet vil jeg springe direkte til konklusionen og derefter skrive lidt om, hvad det her også handler om.

Konklusion

Turen gik godt. Jeg var positivt overrasket over, hvor ”blødt” og kontrolleret FSD (Supervised) kører. Det giver en god tryghedsfornemmelse og en kørerstil, man virkelig kan slappe af til, og dermed koncentrerer sig om trafikken. En kørerstil der ikke på et eneste tidspunkt burde opfattes som værende genererende for medtrafikanterne. (Det er AP ellers ret god til). Der var, næsten, ingen steder, hvor jeg fik en følelse af, at FSDén var i tvivl eller lige skulle beslutte sig for, hvad den nu skulle foretage sig. Dette er ellers noget AP også er rigtig god til. AP har en absolut impulsiv reaktion (oftest negativ), der føles mere som en panikhandling fremfor en gennemtænkt. FSD virker modsat som en erfaren skakspiller, der kan forudsige de næste mange træk.

Det skal dog siges, at trods vi kørte igennem Køge i myldretid (kl 16), så var bilen/systemet ikke rigtig udfordret på noget tidspunkt med fx uforudset hændelser eller andet, der kunne påvirke systemet. Det må blive den dag jeg selv kan få lov at teste systemet og udfordre det på langt mere specifikke situationer.

Jeg var også oprigtig glad for at se, at der på hele turen ikke var noget der hed ”Kurveassistance”. Lige præcis den ”feature” som Tesla introducerede for godt 3 år siden i AP, den har skabt enorme problemer, når man kører med AP. FSD (Supervised) strøg igennem det hele, fuldstændigt som den skulle.

Derudover var jeg oprigtig glad for at se, at bilen faktisk tager farten af INDEN den rammer en restriktiv hastighedsgrænse (hastighedsskilt). Dette er et kæmpe problem med AP og har været der siden jeg startede med at køre Tesla for over 5 år siden. Det skete også på motorveje, dengang AP skiftede hastighed automatisk på motorveje. Automatisk hastighedsændring på motorveje, det holdt AP dog op med for ca 4 år siden.

Fejlene

Jeg noterede mig i alt 4 fejl/uhensigtsmæssigheder.

Den værste fejl var da vi var på vej tilbage mod Tesla Køge og kom kørende af Lyngvejen fra Københavnsvej mod motorvejsafkørsel 32. Af én eller anden årsag forblev bilen i den højre vejbane, der bliver til en drejebane (til motorvejsafkørslen). Og først i sidste øjeblik kom FSD ”i tanke om”, at den skulle lige ud. Det betød, at bilen skiftede vejbane mens den var i drejebanen.

Den fejl bør de få løst ret hurtigt, da det kan udvikle sig til større problemer, hvis der fx ikke havde været plads til at skifte vejbane. Det var der heldigvis. Ved nærmere eftertanke var lidt faktisk ”øv”, for det havde været langt sjovere at opleve hvordan bilen, der nu havde fået manet sig selv ”op i en krog”, ville løse det problem. Det må testes yderligere, næste gang jeg får mulighed for det.

Derudover oplevede jeg nogle fejl med hastigheden. Og netop her kommer årsagen til, hvorfor jeg insisterede på at kører den vej. Det er nemlig fejl som også sker med AP. Og hvad endnu værre er, det er fejl jeg har indmeldt rigtig mange gange i de 4½ år jeg har kørt den rute, uden at de er blevet rettet.

AP på denne strækning har flere end de par hastighedsfejl. Så der var trods alt forbedret noget.

En decideret navigationsfejl, som har eksisteret i 4 år, er tilsyneladende ikke rettet. Fejlen består i, at bilens navigation fortæller, at man skal dreje til højre, et sted hvor man tydeligvis ikke kan/har lyst til at dreje til højre, da det er direkte ind i nogle træer. Den fejl har FSD (Supervised) også. Heldigvis gav den sig ikke til at blinke eller nedsætte hastigheden, som jeg ellers havde frygtet. Men fejlen eksisterer altså stadigvæk trods det, at jeg har indmeldt den igennem næsten et år, uden at det er blevet rettet.

Med det jeg oplevede på den tur, så vil det undre mig meget, om ikke det system snart bliver godkendt til brug på de danske veje. Der er ingen gode argumenter for at ikke gøre det. Det er tydeligt, at det der skal til, det er indlæring (AI skal optimeres) og så nogle få fejlrettelser. Det får man kun, hvis man lader bilerne komme ud og køre.

Bliver Teslas´s FSD (Supervised) ikke godkendt inden længe, så ligger der, efter min opfattelse, uden tvivl en helt anden agenda bag hos beslutningstagerne. Det kan og må ikke være systemets virke, på dette tidspunkt, der skal holde en tilladelse tilbage.

Part 2.

Lidt om sikkerhed

Jf Tesla, så er FSD op til 7 gange mere sikkert end en manuel fremføring. Vi kan altid debattere, hvorvidt disse data er helt korrekte, eller om der pyntet på dem. Jeg vælger i stedet at gå den anden vej og se på logikken. Om tallet ender på 7, 3 eller bare bedre, det er for mit vedkommende ligegyldigt, bare det er bedre (mere sikkert). Eller rettere, at der er potentiale for større sikkerhed. Det er det vigtigste for mig.

Ser vi på det logiske, så er der flere ting der er værd at hæfte sig ved. Fx at bilen er udstyret med væsentlig flere ”øjne” end et menneske. Disse ”øjne” er placeret, så bilen kan se både hvad der foregår foran, men også til siderne og bagtil. Det er noget nær 360 grader, og for et menneske er det fysisk umuligt at gøre det samme. End ikke tilnærmelsesvis.

Bilen er udstyret med en computer. Altså en fysisk teknologi der ikke bliver træt, der ikke bliver distraheret, der ikke indtager stoffer eller alkohol, der ikke er uopmærksom. Computerens opgave er at modtage data fra bla ”øjnene”, analysere disse, fremføre og reagere på dem ud fra en helt bestemt algoritme.

Det banale eksempel kunne fx være, når ”øjnene” ser et rødt lyssignal, så ved computeren at bilen skal stoppe. Computeren beregner så nedbremsningskurven ud fra afstanden til stoppunktet (farepunktet/stoplinjen/foran holdende bil) og farten bilen bevæger sig i. Det er ren matematik. Det samme gør sig gældende, hvis det pludselig er en genstand, der træder ud foran bilen. Her er det værd at notere sig, at når det er en computer, så er den markant hurtigere til at reagere end et menneske er. Den går ikke i panik, den har ikke følelser der kan nedsætte reaktionsevnen. Den reagerer, og den gør det med det samme, uden tøven.

I den ideelle verden kan en computer med disse data praktisk talt ikke fejle. Men vi ved alle, at computere kan fejle. Dels sidder der mennesker bag, der koder systemet. Men også selv elektronikken kan fejle. Så den ideelle verden er én ting, virkeligheden en anden.

For at løse nogle af disse problemer, og ikke mindst når forholdene ændrer sig, så benyttes der det jeg vil kalde for ekstrem AI (kunstig intelligens). Årsagen til jeg kalder det ekstrem er, at der skal behandles en hulens masse data, som dels er kendte faktorer, (som nævnt i eksemplet). Men også data som fx, når forholdene ændrer sig. Hvad når vejen ikke længere er optimal? Der kan fx ligge sne på vejen, eller striberne er efterhånden så slidt, så de er fysisk umulige at få øje på. Her skal computeren lære at kende forskel, og kunne agere ud fra disse faktorer. Det nytter ikke noget at hastighedsskiltet viser 80kmt, hvis forholdene ikke er til at køre den hastighed. Derfor skal computeren lære mange forskellige scenarier, og den skal lære, hvordan den skal behandle og reagerer ud fra disse data. I realiteten er det som at sætte en nyfødt bag rattet, der nu skal skabe sine erfaringer og huske disse. Data bliver fodret til hukommelsen/AI serveren via alt hvad ”øjnene” ser.

På den måde har Tesla samlet en hulens masse data i mange år. Og derfor burde den ”nyfødte” være udrustet temmelig godt til at kunne blive sluppet løs, alene (altså FSD – Fuldt Selvkørende, dog supervised. Dvs overvåget af føreren).

Jeg ser frem til, at jeg kan sætte mig i bilen, indtaste en destination, trykke på ”start”. Og så klare bilen resten herfra, hvor jeg primært skal holde øje med trafikken og være klar til at gribe ind på bremsen og rattet. Og ikke som med AP, der efterhånden er så opmærksomhedskrævende, hvor foden ligger klar på speederpedalen, (sjovt nok ikke på bremsen), for at kompenserer for de tåbeligheder som AP meget ofte laver. Hvor man nærmest konstant skal holde øje med hastigheden, fordi AP alt for ofte ikke kan finde ud af det mest simple. Hvor man nærmest er pinedød nødt til at holde på rattet, fordi AP kan finde på at lave de mest imbecile udsving.

Alene det at man skal sidde klar på speederen og ikke bremsen, det vidner om hvor galt det er gået for AP (Tesla).

Moral og Etik, og ikke mindst økonomi

Det store spørgsmål er så: Vil jeg selv købe FSD (Supervised)? Umiddelbart svar er, nej!

Det kan lyde underligt, når jeg nu nærmest har skamrost systemet. Men jeg er også nødt til at være realistisk og erkende, at Tesla har valgt et forhold til deres kunder, hvor de praktisk talt ikke udviser nogen som helst interesse, hvad angår softwaren, når først de har solgt bilen.

Jeg har kørt Tesla siden december 2020. Dvs i skrivende stund er det godt 5½ år. I den tid har jeg ”deltaget” og dermed accepteret beta-programmet for Autopiloten. I den tid har jeg udfordret den og indmeldt flere fejl. Og flere gange har jeg måtte erfare, at fejl ikke er blevet rettet. Som skrevet herover på min tur med FSD, så kan jeg konstatere, at der stadigvæk er fejl, som jeg tidligere har indmeldt. Jeg har forsøgt at råbe Tesla op om, hvor ”farligt” og tillids svækkende deres måde at håndterer det på er. Hver eneste gang er jeg mødt med tavshed.

Nu er det nået dertil, hvor det er en principsag for mig. Pokker stå i, at jeg skulle betale en relativ stor sum for FSD, uanfægtet at jeg mener det er en kæmpe sikkerhedsmæssig opgradering. Blot for at erfare, endnu engang, at Tesla ikke retter fejlene og i øvrig er ligeglad med kunderne. Dertil har min prøvetur været alt for kort.

Nu er det Tesla der skal overbevise mig om, at de tager det langt mere seriøst, ikke mindst indmeldingerne og dialogen med brugerne. Hvordan de så gør det, det er deres problem.

Hvis FSD bliver gratis tilgængelig i en periode, så vil jeg selvfølgelig udnytte det. Bliver det tilgængelig i en abonnementsform, så vil jeg måske benytte det, i hvert fald i en kort periode for at teste om der er sket fremskridt i forbindelse med fejlretninger.

Jeg havde store forventninger til Tesla og deres software for 5½ år siden. I dag har jeg absolut ingen.

Men at betale godt 60.000, - som tilstandene ser ud lige nu, det kommer bare ikke til at ske.

Jeg mener Tesla selv har valgt, at det er sådan det må være. De har fra start haft alle muligheder for at styre det i anden retning, hvis de ønskede det. Det har de åbenlyst ikke ønsket.

Vil jeg så opfordre andre?

Tiden kan vise, at Tesla har ændret strategi. Og lige nu hænger jeg måske bare fast i enormt dårlige erfaringer med dem, hvad softwaren angår. Så den vurdering vil jeg lade være op til læserne selv at vurderer. Er man ligeglad med hvad Tesla gør/ikke gør, og i øvrig er klar til at betale prisen, så mener jeg helt klart at man skal gå efter det. Der er så kæmpe potentiale i det rent sikkerhedsmæssigt. Der er også tale om en vis form for komfort, selvom det for mig er absolut sekundært.

Men jeg vil til enhver tid opfordre alle til at komme ud og prøve det, også selvom man måske ikke lige har planer om en bil, der skal køre selv. Det er en helt anden oplevelse end vi er vant til. På nogle vil det nok virke enormt udfordrende og ligefrem surrealistisk. Andre, som mig, vil lægge mærke til de små detaljer, og ikke mindst den ro det skaber.

Jeg ser frem til, at det meget snart bliver muligt, at jeg selv sidder bag rattet og skal forsøge drive bilen ud i alskens slags udfordringer, præcis som jeg har gjort med Autopiloten - om Tesla vil det.

Rigtig god fornøjelse!